CrestMuse プロジェクトでは,研究のための研究で終わらないための実用性,関連領域における波及効果に関心をもって研究を進めています.そのためのキーワードが「コミュニティ・人間」です.音楽の認知・知覚モデルの考究、演奏・聴取・音楽デザインに関連した脳機能計測,演奏データベースや音楽情報処理開発用ツールキットの公開,計算機による表情付けコンテストの運営などを行っています.

|

|

「話声を歌声に自動変換する」

齋藤 毅、後藤 真孝

(PDF)

歌詞の朗読音声(話声)を歌声に自動変換する歌声合成システムを提案する.このシステムは,音声分析合成系STRAIGHTによる分析/合成処理過程において,基本周波数,スペクトル,音韻長を制御するモデルによって歌声特有の音響特徴を操作することで話声を歌声に変換する.従来の歌声合成システムに見られるテキストからの歌声合成ではなく,話声からの歌声合成という新しいアプローチを採用することで,高品質な歌声合成だけでなく,「歌詞を朗読するだけで自分の歌声を作り・聴くことができる」という新しい歌声情報処理を可能にした.更に,このシステムによる歌声合成を通じて,歌声を知覚する上で重要な音響特徴を明らかにした.

>>詳細情報

|

|

「音楽のムードを可視化する」

藤澤 隆史、谷 光彬、長田 典子、片寄 晴弘

(PDF)

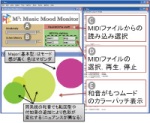

本研究では,楽曲がもつムードの構成要素として個々の和音種がもつ独特の響き(和音性)に注目し,楽曲ムードを色彩で表現する可視化インタフェースの構築を行なった.和音性に関する定量的評価モデルを利用することで入力和音のムードを3つの成分へと分解し,それらを明度,彩度,色相へとそれぞれマッピングすることで出力される色彩を決定する.その結果,個々の和音がもつ微妙なニュアンスの違いを色彩の違いで表現することが可能となった.

|

|

「聞き方の違いを脳機能計測で確認する」

松井 淑恵、風井 浩志、片寄 晴弘

(PDF)

音楽家は、同じ音楽を聞いていても「コンクールの演奏審査をしているとき」と「音楽の構成をわかろうとしているとき」のように、"聞き方"を変化させることができる。本研究では、そのような"聞き方"の違いが脳の活動にどのように反映されているかを、fNIRS(機能的近赤外線分光法)を用いて計測した。計測結果から、「音楽の構成をわかろうとしているとき」に活動する部位は左半球の前頭前野の外側下部であることがわかった。同時に、前頭前野の背側部で活動の低下がみられた。耳から入ってくる音楽の違いだけでなく、音楽の"聞き方"という主観的な状態の違いによっても脳の活動が異なることが確認された。

|

|

「一流ピアニストによる打鍵動作の上肢運動制御」

古屋 晋一、片寄 晴弘、木下 博

(PDF)

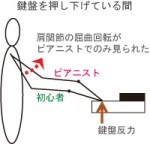

一流ピアニストは、長時間演奏しても、どうして手や腕が疲れないのか?本研究は、その背景に隠された身体運動スキルについて紹介する。コンクール入賞歴のあるピアニスト7名と同数のピアノ初心者が、さまざまな音量でピアノの鍵盤を打鍵する際の、肩から指先までの運動を高速度カメラによって計測した。計測した身体運動情報にロボティクスの計算手法を用いることによって、打鍵動作中に肩、肘、手首、指関節に生じる「筋力」と、慣性力や遠心力、重力といった「筋力以外の力」を算出した。その結果、ピアニストは、筋力以外の力を効果的に利用することによって、打鍵時の筋肉の仕事量を軽減する熟練運動技能を獲得していることが明らかとなった。本研究は、「科学による音楽家への貢献」を目指して実施されたものであり、本研究結果は、ピアノ演奏や指導の現場に、表現支援や故障発症の予防の点から有意義な情報を提供する。

|

|

「ピアノ演奏動作のリアルタイムCG 表現」

釘本 望美、山本 和樹、武田 晴登、片寄 晴弘、長田 典子、巳波 弘佳

(PDF)

演奏動作は音楽演奏における重要なファクターの1つである.とりわけピアノ演奏動作の生成やCG表現技術の研究においては,これまでピアノ練習支援システムや演奏支援GUIなど機械的な指の動きを扱ったものが多く,動きのリアリティに着目した研究は少ない.本研究では,モーションキャプチャを用いてピアノ演奏時の手指の動きを獲得し,オフラインレンダリングによってリアルなピアノCGアニメーションを制作するとともに,リアルタイムレンダリングにより音楽インタフェースiFPと同期するGUIを構築する.

|

| top |